خوارزميات التصنيف التي تعتمد على الإنتخاب

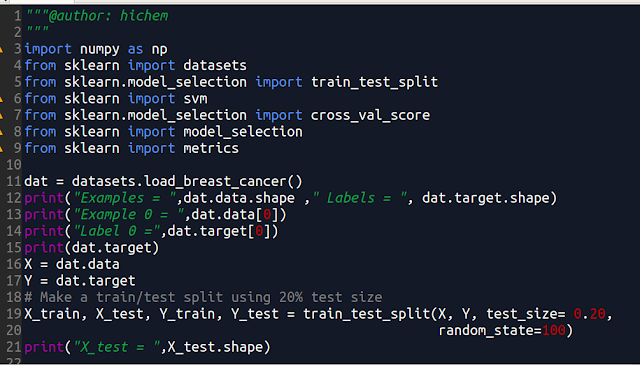

Voting Classifiers فرضا أنه لدينا مشكلة صعبة و أردنا إستشارة الأخرين فأكيد كلما إستشرنا أكثر كلما حصلنا على قرار أفضل لأننا ببساطة نعلم أن رأي الجماعة أكثر حكمة من رأي الفرد و هذا ما يسمى ب "The wisdom of the crowd". في مجال تعلم الألة نطبق هذا المبدأ بجعل مجموعة من الخوارزميات تشارك في عملية إتخاد القرار و الرأي الذي يحظى بالأغلبية يختار و يطلق على هذه العملية (Hard voting classifier). الصورة 1 مكتبة (Scikit-Learn ) توفر لنا إطار عمل يسهل علينا برمجة طريقة الإنتخاب بين مجموعة من المصنفات و هو (VotingClassifier). كمثال تطبيقي نستعمل قاعدة البيانات الجاهزة (breast_cancer) و التي تحتوي علي (Examples = 569, Features = 30)، في هذا المثال إستعملنا ثلاث خوارزميات و هم LogisticRegression RandomForestClassifier و SVM. بعد ذلك نعرف المصنف الذي يعتمد مبدأ الإنتخاب في السطر 22 - الصورة 1، و نقدم له هذه الخوارزميات كمدخلات ليعمل عليها مع المدخل (voting = hard) لأنه توجد أنواع أخرى من طرق الإنتخاب. هو سيقوم بتدريب هذه الخوارزميات الثلاث و بعدها يعيد تطبيقها على الداتا...